目次

1. 序章:AI規制法案の必要性

AI技術の急速な発展と規制の必要性

人工知能(AI)技術は、過去数十年で顕著な進歩を遂げ、私たちの生活のあらゆる側面に浸透しています。AIによって、医療診断から交通システム、さらには個人の日常生活に至るまで、多大な便利さと効率がもたらされています。しかし、この技術革新の波は、プライバシーの侵害、偏見や差別の増大、透明性の欠如など、数多くの懸念を引き起こしています。これらの課題に対処し、AI技術の発展を健全かつ責任あるものに導くために、規制が急務となっています。

EUのAI規制法案の概要と目的

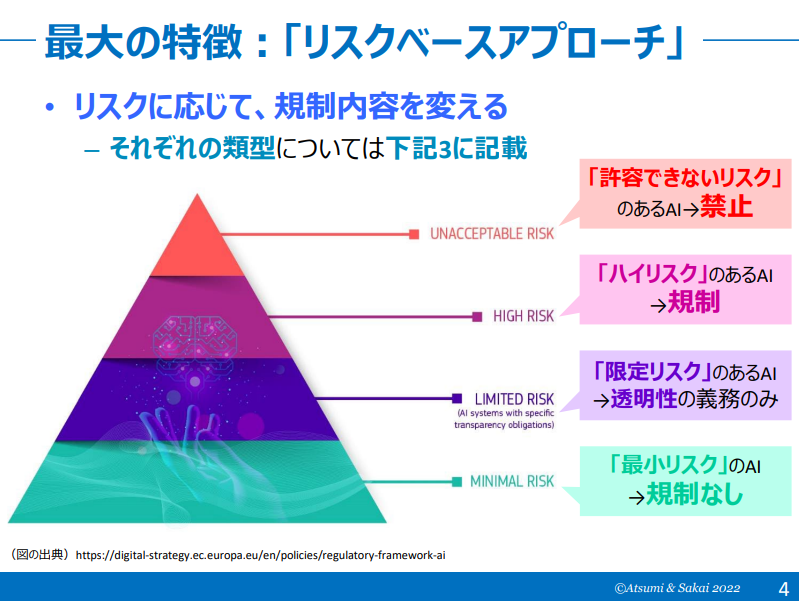

欧州連合(EU)は、この課題に対応するためにAI規制法案(AI Act)を提案しました*1-2。この法案は、AI技術のリスクを基にした総合的な規制フレームワークを定めており、AIのリスク(健康、安全、基本権への影響など)に対処することを目的としています。加えて、AIの導入や投資を促進し、イノベーションを強化することも目指しています。AI Actは、リスクに基づいたアプローチを採用し、リスクの度合いに応じて異なるレベルの規制を適用します。この法案は、EU域内だけでなく、EUの市場にサービスを提供する国外の事業者にも適用されるため、国際的な影響を持ちます。

参考文献:

1: Shaping Europe’s digital future: AI Act

2. AI規制法案の主要な特徴

3. ハイリスクAIシステムに対する要件

ハイリスクAIシステムの定義と例

ハイリスクAIシステムは、その使用が人々の健康、安全、基本的人権に重大な影響を与える可能性があるAIシステムです。EUのAI規制法案では、ハイリスクAIシステムを特定の分野や用途に基づいて定義しています。例えば、重要なインフラの管理、教育や職業訓練、雇用や労働者管理、重要な公共サービスへのアクセス、法執行、移民管理、司法システムなどがこれに含まれます。これらの分野で使用されるAIシステムは、個人の権利や生活に直接的な影響を及ぼすため、厳格な規制の対象とされています。

要件と遵守:リスク管理、データガバナンス、透明性

ハイリスクAIシステムに適用される要件には、リスク管理、データガバナンス、透明性、人間による監視、技術文書の提供、記録の保持などが含まれます。これらの要件は、ハイリスクAIシステムが安全かつ信頼できる方法で使用され、個人の権利を尊重し、説明責任を持って運用されることを確保することを目的としています。

- リスク管理: ハイリスクAIシステムの提供者は、システムのライフサイクル全体にわたってリスクを評価し、軽減するためのリスク管理システムを実装する必要があります。

- データガバナンス: 使用されるデータの品質、関連性、そしてプライバシーを保護するための適切なデータガバナンス手順を確立する必要があります。

- 透明性: ユーザーがAIシステムの動作を理解し、その判断を信頼できるように、システムの透明性と説明可能性を確保することが求められます。

さらに、ハイリスクAIシステムは適合性評価を受け、EU適合宣言を取得し、CEマーキングを行うことで市場への提供が許可されます。これは、システムがEUのAI規制法案で定められた基準に適合していることを証明するものです。

施行と監督

ハイリスクAIシステムに関する規制の施行と監督は、各EU加盟国に設置される国家監督機関によって行われます。これらの機関は、AIシステムの適合性評価の監督、市場監視、違反に対する調査および執行措置を担当します。違反が発見された場合、重大な罰金や市場からの撤退命令など、厳しい制裁が科される可能性があります。

ハイリスクAIシステムに対するEUのアプローチは、技術イノベーションを促進しつつも、社会的価値と個人の権利を保護するというバランスを目指しています。この規制は、AI技術の責任ある使用と持続可能な発展を促進することを意図しています。

4. 限定リスクと最小リスクAIの義務

透明性の義務とその適用例

EUのAI規制法案では、リスクの程度に応じてAIシステムに異なる義務を課しています。限定リスクAIシステムは、主に透明性に関する要件が課されます。これは、ユーザーがAIシステムとの相互作用を理解し、意思決定の背景にあるプロセスに対する洞察を得ることを目的としています。例えば、チャットボットや顧客サービスを自動化するAIシステムは、ユーザーに対してそれがAIによる対話であることを明示する必要があります。また、ディープフェイク技術を使用して生成されたコンテンツは、そのコンテンツが人工的に生成されたものであることをユーザーに知らせる義務があります。

AIシステムの利用者と提供者への影響

限定リスクAIに対する規制は、AIシステムの透明性とユーザーの理解を促進することを目指しています。これにより、AIシステムの利用者は、自分がAIによって生成された回答やコンテンツと対話していることを認識し、その情報をどのように解釈するかについてより良い判断ができるようになります。一方、AIシステムの提供者は、透明性の基準を満たすために、AIシステムの設計と運用においてユーザーへの情報提供方法を工夫する必要があります。これは、ユーザーの信頼を獲得し、AI技術の社会的受容を高める上で重要な要素です。

最小リスクAIに対しては、特に規制は課されませんが、全てのAIシステムに共通する倫理的ガイドラインやベストプラクティスに従うことが推奨されます。これにより、AI技術の責任ある使用とイノベーションの促進を両立させることが目指されています。

5. イノベーション支援とサンドボックス制度

サンドボックス制度の目的と概要

EUのAI規制法案は、AI技術の革新と実用化を促進するためのサンドボックス制度を導入することを提案しています。このサンドボックス制度の主な目的は、革新的なAIシステムの開発者が、実際の市場環境に近い条件下で、新しい技術やサービスを試験・検証できる安全な環境を提供することにあります。これにより、リスクを最小限に抑えつつ、イノベーションを加速させることが可能になります。

小規模提供者とスタートアップへの支援

サンドボックス制度は特に、リソースが限られる小規模提供者やスタートアップ企業にとって重要な支援策です。EUは、これらの事業者がAI技術の革新において重要な役割を担うと認識しており、彼らが直面する可能性のある規制上の障壁を低減するための措置を講じています。サンドボックスを利用することで、これらの事業者は、規制当局と直接対話しながら、新しいAIシステムの開発とテストを進めることができ、法規制の遵守に関するガイダンスを受けることも可能です。

サンドボックスの具体的な適用例

サンドボックス制度により、AIシステムの開発者は、例えば健康管理、交通、教育など、特定のセクター向けのAIアプリケーションを試験的に展開できるようになります。この過程で、データ保護、安全性、ユーザーの透明性などの要件を満たしながら、製品やサービスの実用性と効果を検証することができます。

6. 施行スケジュールと規制の適用

EUのAI規制法案(AI Act)の施行スケジュールと規制の適用については、世界中のAI開発者、提供者、そして利用者にとって重要な影響を及ぼします。この法案は、AI技術の責任ある利用と発展を目指し、そのリスクを管理するために設計されています。以下に、施行スケジュールと規制の適用に関する主要なポイントを解説します。

法案の施行時期と移行期間

AI規制法案の施行時期は、2022年後半と予想されています。しかし、法案が正式に施行されるまで、そして規制が完全に適用されるまでには、一定の移行期間が設けられます。この移行期間中に、関係者は新しい規制に適応し、必要な準備を整えることが求められます。2023年12月の時点の予定で、最速で2024年後半には、事業者向けの完全施行が行われる予定です。この間、EUは具体的な基準や適合性評価の手続きなど、法案の詳細を詰める作業を進めます。

完全施行に向けた準備

EU加盟国、AI技術の提供者、利用者は、完全施行に向けて準備を進める必要があります。これには、リスク管理システムの構築、データガバナンスの強化、透明性や安全性の確保などが含まれます。特に、ハイリスクAIシステムを提供する事業者は、適合性評価を受け、EU適合宣言を作成するなど、厳しい要件を満たす必要があります。

国際的な影響と準備

EUのAI規制法案は、EU内の事業者だけでなく、EU市場にサービスを提供する全世界の事業者に適用されます。これにより、日本や米国などの国外に拠点を持つAI事業者も、EUの規制に準拠するための対策を講じる必要があります。規制の域外適用は、グローバルなAI産業に対する法的な影響を及ぼすため、国際的な調整や協力がますます重要になります。

7. AI規制法案の監督と執行

EUのAI規制法案は、AI技術のリスクを管理し、イノベーションを促進することを目的としています。この法案には、AIシステムの使用に関連するリスクを評価し、適切な管理措置を講じるための監督と執行のメカニズムが含まれています。以下では、AI規制法案における監督と執行の仕組みについて詳しく解説します。

欧州委員会とAI事務局の役割

- 欧州委員会: 欧州委員会は、AI規制法案の全体的な監督を担当し、加盟国が法案の要件を適切に実施しているかを監視します。また、規制の一貫した適用を保証し、加盟国間の調整を促進する役割も果たします。

- AI事務局: AI事務局は、AI規制の実施に関する専門的な支援と指導を提供するために設置されます。この事務局は、AIシステムの分類、リスク評価、遵守状況の監視に関するガイドラインやツールを開発し、AI技術に関する最新の知見を共有します。

違反時の制裁と罰則

AI規制法案では、法案の要件に違反した場合に課される具体的な制裁と罰則が定められています。これらの措置は、AIシステムの使用によるリスクを最小限に抑え、基本権の保護を強化するために重要です。

- 制裁: 違反した企業や組織には、罰金が課されることがあります。罰金の額は、違反の重大性や影響の範囲、企業の規模に応じて異なりますが、最大で全世界売上の一定割合(例えば6%や7%)に達することもあります。

- 罰則: 重大な違反の場合、AIシステムの市場からの撤回や使用禁止など、より厳しい措置が講じられることがあります。これにより、高リスクAIシステムに関連する潜在的な害から市民を保護することを目指します。

監督と執行のための国際的な協力

AI技術は国境を越えて使用されるため、効果的な監督と執行は国際的な協力を必要とします。EUは、他の国々や国際機関と連携し、AIの安全性と信頼性を高めるための共通の基準や原則の策定に取り組んでいます。

8. 結論:AI規制法案の将来と期待

EUのAI規制法案(AI Act)は、技術の進化と社会におけるその応用がもたらすリスクに対応するための重要な一歩です。この法案は、AI技術の安全な使用と持続可能な発展を促進することを目的としています。以下では、AI規制法案の将来と期待について概説します。

AI技術の責任ある利用とイノベーションの促進

AI規制法案は、AI技術が人々の生活を豊かにする可能性を最大限に引き出しつつ、そのリスクを最小限に抑えるためのバランスを見つけることを目指しています。AI技術の責任ある利用は、社会全体の信頼を築く上で不可欠です。この法案は、イノベーションを促進するための安全な枠組みを提供し、AI開発者とユーザーに明確なガイドラインを与えます。これにより、AI技術が人権を尊重し、民主的な価値観を守りながら発展することが期待されます。

EUと国際社会におけるAI規制の展望

EUのAI規制法案は、世界的なAI規制のモデルとなる可能性があります。EUは、AI技術の規制において国際的な協調を促進し、グローバルな基準を設定するリーダーシップを発揮することができます。国際社会においても、AIのリスク管理とイノベーション促進のために、EUのアプローチから学び、適応することが期待されます。このような国際的な連携は、AI技術のポジティブな影響を最大化し、潜在的なリスクを効果的に管理するために不可欠です。

まとめ

EUのAI規制法案は、技術の急速な進化に対応し、AIの責任ある利用を促進するための重要なステップです。この法案は、AI技術が人々の生活を豊かにし、社会にプラスの影響を与えるための安全な枠組みを提供します。また、EUはこの法案を通じて、国際社会におけるAI規制のモデルを提供し、グローバルな協調とイノベーションを促進することを目指しています。AI技術の将来は明るく、この法案はそのポテンシャルを実現するための基盤となることが期待されます。

本ブログ記事ではChatGPTによる文章出力および画像生成を部分的に用いています。